Journée d’étude : L’intelligence artificielle générative et l’enjeu des données personnelles

Journée d’étude CREIS-TERMINAL en partenariat avec LabSIC-USPN

L’intelligence artificielle générative et l’enjeu des données personnelles

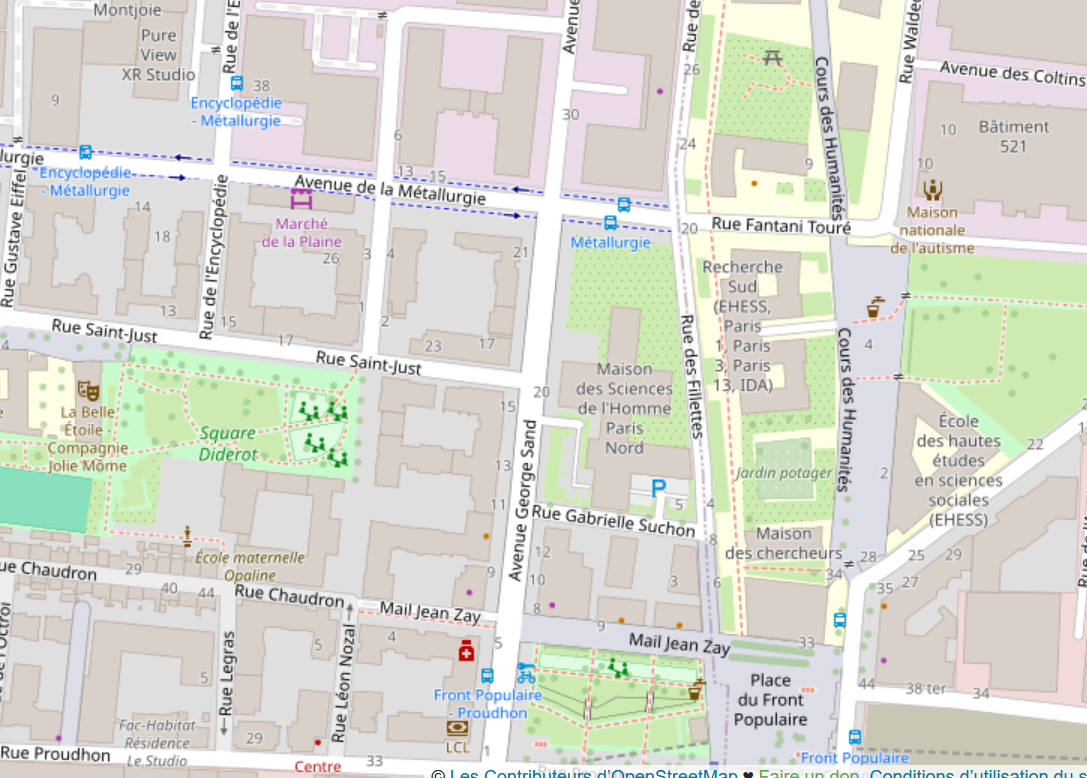

vendredi 29 novembre 2024 MSH Paris Nord salle 413 et en ligne

L’intelligence artificielle (IA) est un ensemble de techniques qui remontent aux années 1940-1950 avec les travaux de Turing, de Wiener. Supposée simuler à l’aide de machines le raisonnement humain, l’IA s’appuie sur des modèles mathématiques, algorithmiques, informatiques. La technologie informatique a connu plusieurs évolutions avec les systèmes experts qui permettent de reproduire le raisonnement d’un expert (par exemple médecin pour un diagnostic de santé), les réseaux neuronaux qui s’inspirent de la biologie (neurones et synapses) pour raisonner souvent avec des méthodes d’apprentissage probabilistes, le machine learning (apprentissage automatique) qui permet d’apprendre à partir de données massives, le deep learning (apprentissage profond) qui repose sur l’apprentissage des significations des données. L’apprentissage automatique et l’apprentissage par renforcement permettent à partir de l’analyse de données massives de déduire des règles à suivre dans le système d’IA. L’un des défis est l’apprentissage du langage naturel ; récemment avec les LLM (large languages models) est apparue l’intelligence artificielle générative, c’est-à-dire une IA qui a la capacité de créer, que ce soit le texte (ChatGPT, projet OpenAI), l’image (DALL-E et Midjourney), le son (Suno) ou la vidéo (Sora). Avec ChatGPT qui a atteint en l’espace de cinq jours 1 million de comptes créés et le buzz médiatique. Ainsi, l’IA générative est devenue un phénomène de société dès fin 2022. L’IA générative dépasse les systèmes de recommandation (comme sur Amazon, Booking), ceux de score par les banques pour discerner les profils des clients. Les nouvelles promesses opèrent dans les secteurs de la justice (prédictive), de la santé, de la sécurité (vidéosurveillance et identification algorithmiques, reconnaissance faciale et biométrie). Mais les avancées technologiques peuvent servir le deepfake (hypertrucage pour les photos et les vidéos par exemple mais aussi pour des textes vraisemblables mais faux), ainsi que le pillage de données qui enfreint les droits des créateurs, en les agrégeant pour fournir des réponses probabilistes. Il existe aussi des fausses IA avec des travailleurs du clic qui effectuent des micro-tâches sous-payées (Casilli, 2019). L’IA générative, à la capacité de calcul impressionnante, présente aussi des limites avec les biais relatifs aux données sous ou sur-représentées, avec l’absence de mention des sources et des hallucinations (production d’informations fausses ou erronées). L’IA générative présente en outre des risques pour les données personnelles. En effet, la question de l’exploitation des données comportementales et personnelles se pose en termes de menaces, d’autant plus que dans ce contexte technologique le RGPD ne suffit pas pour les protéger. Vécu, aux débuts, comme une contrainte par les entreprises se sentant sous injonction règlementaire, les discours du MEDEF mettent désormais en avant la mise en conformité. Tels sont les enjeux, parmi d’autres, abordés lors de cette prochaine journée d’étude.

Selon une profonde ambivalence, l’IA générative permet certes des avancées mais dans le même temps déploie les conditions de surveillance et traitement-exploitation des données en lien avec ces avancées. L’opacité des algorithmes ne permet pas de connaître leur conception et mise en œuvre, afin de participer à la gouvernance des développements en matière d’IA générative, ou de cerner exactement la surveillance, la traçabilité et l’exploitation des données. Le consentement, face aux injonctions technologiques, conduit à l’acceptabilité de l’IA générative au nom de l’innovation dans un contexte d’économie numérique fondée sur des algorithmes, l’IA et l’exploitation de données d’usages collectées. La démultiplication des services attire ainsi les utilisateurs-consommateurs, dont l’attention est devenue une ressource dans le cadre de l’économie de l’attention, faisant partie de la surveillance des données, que Shoshana Zuboff (2019/2022) inscrit dans le capitalisme, non plus structuré par la propriété des moyens de production mais celle des outils de traçage et exploitation des données comportementales, voire de leur orientation pour conseiller/personnaliser en lieu et place de la manipulation, supportée par l’invasion des plateformes.

La protection des données dans un contexte de sophistication informatique avec les algorithmes et l’intelligence artificielle, pour toujours plus de traçabilité et d’exploitation de données doit donner encore lieu à la vigilance, sans nier les avantages de l’informatique et de l’intelligence artificielle. Cette dernière fondée sur une économie des données représente un enjeu informatique et société majeur puisque la captation permanente des données est nécessaire pour nourrir les systèmes d’intelligence artificielle, qui fait désormais l’objet d’un « AI Act » : « l’Union (européenne) doit agir en tant qu’organisme normatif mondial en matière d’IA ». En France, la mesure est prise avec un « avis relatif à l’impact de l’intelligence artificielle sur les droits fondamentaux » en avril 2022 .

À l’heure des développements de l’intelligence artificielle qui provoquent des craintes (communiqué CNIL du 8/07/2021) et font l’objet de travaux de réglementation, la recherche Informatique et Société, qui a tôt travaillé les enjeux sociaux de la surveillance, se préoccupe de l’intelligence artificielle qui renouvelle les systèmes biométriques pour traquer des profils d’individus, pour servir des intérêts sécuritaires et économiques, à la frontière de la discrimination interdite en vertu de l’article 21 de la Charte des droits fondamentaux de l’Union européenne. L’IA vise à automatiser les déductions exigeant des traitements massifs de données (non pas seulement personnelles, mais par recoupements sophistiqués, et avec des machines apprenantes en permanence). Les régulations et cadres réglementaires sont-ils suffisants pour protéger des droits inaliénables ? La demande d’une éthique ne suffit pas, même s’il s’agit d’engager des compromis dans le cadre de régulations en cours, avec le renfort des lois. La question concerne aussi le consentement : à l’heure des traitements par les systèmes d’IA, est-il vraiment éclairé ?